18.06.2020 | Lesezeit ca. 9 Minuten

Eine Reise in den Mittelpunkt menschlichen Denkens.

Eine Frage im Podcast zieht sich nun schon wie ein roter Faden durch jede Folge: Was ist eigentlich…? Es ist die Frage nach einer Definition, nach einer begrifflichen Distinktheit, die Frank Siepmann immer wieder an seine Gäste richtet: Was ist eigentlich agiles Lernen? Was ist Blockchain?

Was ist eigentlich KI?

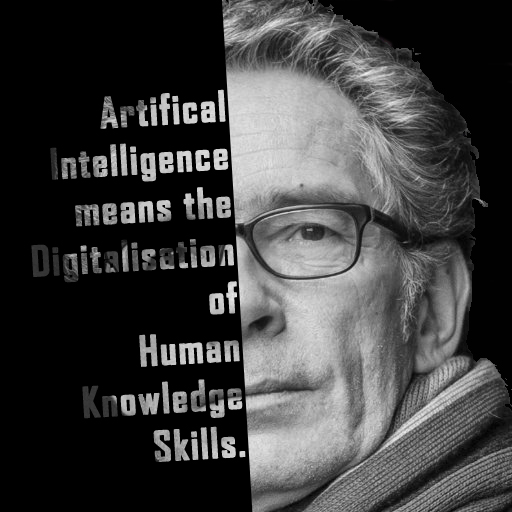

Die Gäste reagieren darauf meist gelassen – so auch Herr Reinhard Karger vom DFKI: Schließlich sind Definitionen in der Forschung elementar: Sie legen in kurzen Sätzen fest, was ein Begriff mit einschließt – und was nicht. Für Künstliche Intelligenz schlägt Reinhard Karger folgende Definition vor: „Künstliche Intelligenz ist die Digitalisierung menschlicher Wissensfähigkeiten.“ Da kommen bei den meisten Lesern wohl eher Fragezeichen hinzu, als dass sich welche auflösen. Denn „Wissensfähigkeiten“ ist ein weit gefasster Begriff, der der Definition selbst einen sehr großen Interpretationsspielraum gibt.

Und das hängt primär damit zusammen, dass er sich nicht Googlen lässt. Daher möchte ich an dieser Stelle kurz auf eine etymologische Deutung dieses Wortes eingehen, um etwas mehr Klarheit in Herrn Kargers Ansatz zu bringen. Als Kompositum setzen sich Wissensfähigkeiten aus dem Begriff Wissen und Fähigkeiten zusammen. Das Oxford-Wörterbuch definiert Wissen als: „Gesamtheit der Kenntnisse, die jemand [auf einem bestimmten Gebiet] hat“. Allerdings dominiert in der Wirtschaft eine eher praxisorientiert ausgerichtete Definition. Das Gabler Wirtschaftslexikon bietet folgende Erklärung an, die sich auch bei Anbietern und Co. bereits durchgesetzt hat: Wissen ist „die Gesamtheit der Kenntnisse und Fähigkeiten, die Individuen zur Lösung von Problemen einsetzen. Wissen basiert auf Daten und Informationen, ist im Gegensatz zu diesen aber immer an eine Person gebunden.“ Und auch bei der Definition von Fähigkeiten ist die Definition im Gabler Wirtschaftslexikon sehr viel treffsicherer: Fähigkeiten sind die „geistige, praktische Anlage, die zu etwas befähigt. Voraussetzung, die neben der Motivation zur Leistungserbringung erforderlich ist (Leistung = Motivation · Fähigkeit). Fähigkeiten können sowohl angeboren (Begabungen) als auch erworben (Fertigkeiten) sein und variieren nach dem Grad ihrer Ausprägung von Person zu Person.“

Auch wenn Reinhard Karger bei der Begründung seiner Wahl ein wenig in die Schwimmen gerät: „Aber ich würde das gerne als eine Formel motivieren, die handhabbar ist und Orientierung bietet und Desorientierung vermeidet.“, wählt er einen Ansatz zur Definition von KI, der in erster Linie anthropogen geprägt ist. So verhält es sich auch mit der starken und schwachen KI, die Herr Reinhardt als die beiden „Pole“ identifiziert. Hierbei stellt die schwache KI nach seiner Auffassung Werkzeuge da, die schwache KI dagegen ein „integriertes System, das in sämtlichen Dimensionen menschlicher Intelligenz die Leistung des Menschen erreicht oder überschreitet“. Künstliche Intelligenz als etwas, das nicht nur vom Menschen aus geht, sondern auch an ihm gemessen wird. Diesen Ansatz verfolgt Herr Karger sehr stringent: Bezogen aus den Punkt an dem sich Künstliche Intelligenz der Theorie nach vom Menschen entkoppeln würde – also der Moment, indem „ein System einen Zustand erreicht hat, wo er in all diesen Wissensfähigkeiten den menschlichen Stand erreicht hat und aber von dem Moment an sehr schnell und sehr viel besser und leistungsfähiger als ein Mensch ist“ und den Karger als Singularität beschreibt – spricht Reinhard Karger plötzlich von „Hollywood“. Für ihn etwas, dass „sehr, sehr weit weg von dem [ist], was man heutzutage eigentlich kann“ und sogar eine „fehlende Wertschätzung für die menschlichen Vermögen.“ Hierbei verweist er insbesondere auf den ungenügenden Forschungsstand bezogen auf den gesunden Menschenverstand, welchen wir „immer noch nicht verstehen und nicht würdigen.“ Da facto können wir mehr über Künstliche Intelligenz erfahren, wenn wir proportional dazu den menschlichen Verstand weiter erforschen und vielleicht versuchen, diesen in einer Mimikry nutzbar zu machen. Gleichzeitig ist die KI-Forschung an die Anthropologie gebunden, sodass sie durch sie auch behindert oder nur verlangsamt werden kann.

So verhält es sich auch mit der starken und schwachen KI, die Herr Reinhardt als die beiden „Pole“ identifiziert. Hierbei stellt die schwache KI nach seiner Auffassung Werkzeuge da, die schwache KI dagegen ein „integriertes System, das in sämtlichen Dimensionen menschlicher Intelligenz die Leistung des Menschen erreicht oder überschreitet“. Künstliche Intelligenz als etwas, das nicht nur vom Menschen aus geht, sondern auch an ihm gemessen wird. Diesen Ansatz verfolgt Herr Karger sehr stringent: Bezogen aus den Punkt an dem sich Künstliche Intelligenz der Theorie nach vom Menschen entkoppeln würde – also der Moment, indem „ein System einen Zustand erreicht hat, wo er in all diesen Wissensfähigkeiten den menschlichen Stand erreicht hat und aber von dem Moment an sehr schnell und sehr viel besser und leistungsfähiger als ein Mensch ist“ und den Karger als Singularität beschreibt – spricht Reinhard Karger plötzlich von „Hollywood“. Für ihn etwas, dass „sehr, sehr weit weg von dem [ist], was man heutzutage eigentlich kann“ und sogar eine „fehlende Wertschätzung für die menschlichen Vermögen.“ Hierbei verweist er insbesondere auf den ungenügenden Forschungsstand bezogen auf den gesunden Menschenverstand, welchen wir „immer noch nicht verstehen und nicht würdigen.“ Da facto können wir mehr über Künstliche Intelligenz erfahren, wenn wir proportional dazu den menschlichen Verstand weiter erforschen und vielleicht versuchen, diesen in einer Mimikry nutzbar zu machen. Gleichzeitig ist die KI-Forschung an die Anthropologie gebunden, sodass sie durch sie auch behindert oder nur verlangsamt werden kann.

Künstliche Intelligenz muss also menschenähnlich sein und seine Qualitäten auch aus seiner Menschenähnlichkeit beziehen. Diese Zentralisierung der menschlichen Vermögen – wie Karger sich ausdrücken würde – findet sich auch in der Definition von Dr. Kai Liebert und Andreas Talg.

Als Head of Global Learning Campus bei der Siemens AG war Herr Dr. Liebert bereits in die verschiedensten Projekte rund um eLearning und Künstlichen Intelligenz (Artificial Intelligence) beteiligt – seit April arbeitet er jetzt an eine Projekt, dass er als „the coolest project ever :)„ beschreibt: Learning and Education ‘Zukunftsfonds – struktureller Wandel in Deutschland’.

Herr Talg dagegen ist Head of Global Operations Management and Technology Based Learning des Global Learning Campus und Head of Learner Experience Platforms. Zusammen bringen es die beiden auf über 30 Jahre Berufserfahrung im Bereich eLearning und gelten damit als führende Experten auf diesem Gebiet.

In ihrem Aufsatz: “Künstliche Intelligenz und das Lernen der Zukunft” definieren sie KI als ein „Teilgebiet der Informatik“, dass „versucht, menschenähnliche Intelligenz in Computersystemen nachzubilden.“ Aber auch hier wird deutlich, wie eng diese Definition gefasst ist und wie wenig Spielraum sie zulässt: Muss KI immer computergebunden sein? Warum ist KI primär ein Teilgebiet der Informatik – und nicht der Psychologie oder Philosophie? Und störend ist auch die Zielrichtung beider Definitionen: Schließlich spricht Herr Karger nicht von einem „Versuch der Digitalisierung menschlicher Wissensfähigkeiten“ und hat damit einen stärkeren Bezug zur praktischen Anwendbarkeit von KI. Gleichzeitig ist die Definition von Liebert und Talg durch die Verwendung des Begriffs „menschenähnliche Intelligenz“ statt „menschliche Vermögen“ und „Wissensfähigkeiten“ positiver konnotiert: Intelligenz beinhaltet die Idee, dass nur „gute“ Eigenschaften in Computersystemen nachgebildet werden. Kargers Definition erscheint dagegen werturteilsfrei und damit allgemein gültig.

Künstliche Intelligenz und Veränderungskultur

Glaubt man der Einschätzung von Dr. Kai Liebert und Andreas Talg gegangen, wäre wohl „centric“ das Buzz Word des Jahres 2018 geworden. Aber „centric“ ist in Zusammenhang von „Wissenschaft trifft Praxis“ keine Handlungsempfehlung – schon gar keine, die sich leicht umsetzen lässt. Das Buzz Word des Jahres 2020 wird es darüber hinaus definitiv nicht – hier hat das Hashtag #Covid-19 für dieses Jahr wohl jedem Buzz Word den Rang abgelaufen. Neben diesem Trend hat meines Erachtens aber das Wort „Change“ die besten Chancen, Hotkey des Jahres zu werden – „Change“ und „Try“. Und damit kommen wir zu den praxisbezogenen Aspekten, die man aus dem Podcast mit Reinhard Karger mitnehmen kann.

Den mit der Künstlichen Intelligenz einher geht immer ein Veränderungsprozess von Mitarbeitern und vom Unternehmen selbst. Die Implementierung von KI bedeutet nicht nur die neue Systematisierung von Datenströmen, sondern auch die Etablierung einer Kollaborationskultur zwischen den KI-gestützten Systemen und den Mitarbeitern. Auf diesen Zusammenhang geht Reinhard Karger ein und verweist auf die typischen ethischen Grundlagen, die man bereits aus Roboter-Science-Fiction-Filmen kennt: „Wenn ein Mensch sich ihnen [den Leichtbaurobotern] annähert, dann möchte man nicht, dass der Mensch verletzt wird.“ Die Lösung des DFKI für diese substanzielle Frage ist ebenso simpel wie genial: „Verlangsamung“. Dazu lässt das DFKI die gesamte Laborsituation mit Menschen und Leichtbaurobotern durch eine Webcam beobachten:

„Diese Webcam setzt neuronale Netze oder Deep Learning ein und kann jetzt ermitteln, dass ein Mensch diesem Roboter so nahekommt, dass eine Berührung nicht mehr auszuschließen ist. Es stoppt diesen Roboter aber nicht komplett, sondern reduziert die Geschwindigkeit der Aktorik, sodass eine Bewegung nur noch in Zeitlupe stattfinden kann. Das wiederum bedeutet, dass es kein Sicherheitsproblem gibt.“

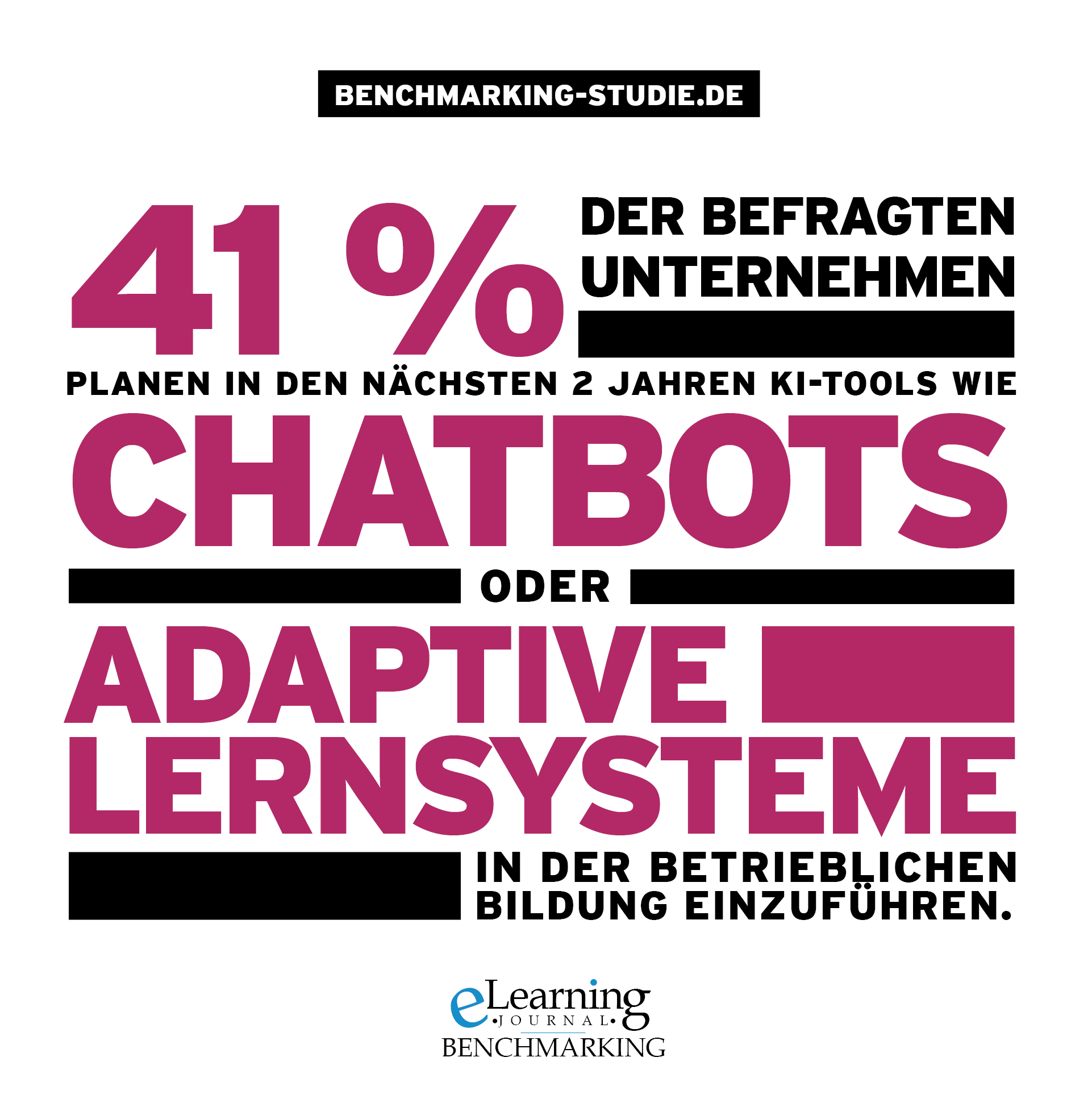

Sobald die Hürde der Angst zwischen Menschen und Maschine aufgelöst wurde – der Mensch die Maschine also nicht als Lebensgefahr wahrnimmt – sind die nächsten Schritte im Veränderungsprozess möglich. Insbesondere in Bezug auf die betriebliche Bildung ist der Einsatz von KI nur dann möglich, wenn sich der Mensch – der Lernende – auch aktiv mit der KI auseinandersetzt: „So viel KI wie wir auch immer einsetzen wollen, wenn es um das Lernen geht: Es wird nicht gehen ohne das Engagement, ohne die Arbeit des Lerners. Er kann nicht gezwungen werden, sondern muss aus eigener Motivation mitmachen.“ Diese Kooperation zwischen KI und Mensch ist jedoch nur dann möglich, wenn alle Ängste und Gefahren, die der Mitarbeiter der KI entgegenbringt, abgebaut worden sind – und dieser Prozess ist durch die Installation einer Webcam keinesfalls abgeschlossen. Dabei fällt auf, dass das von Reinhard Karger beschriebene Mind-Set, dass erforderlich ist, um KI im Unternehmen implementieren und Mensch und KI langfristig erfolgreich zusammenwirken lassen zu können dem Mind-Set ähnelt, das Frau Prof. Dr. Nele Graf in der Vorwoche zum Thema: “Agiles Lernen” umrissen hat: Hier zeigt sich bereits vage, dass agile Lernmethoden ein Mind-Set fördern, dass auch die erfolgreiche Auseinandersetzung der Mitarbeiter mit KI fördern könnte. In Fällen, in denen die Ängste und Sorgen, die der Mitarbeiter gegenüber KI empfindet, jedoch auf falschen Erwartungen beruhen, lassen sich diese zumeist sehr viel schwieriger abbauen. Diesen Aspekt thematisierte Reinhard Karger bereits auf der LearnTec in Karlsruhe während seines Keynote-Vortrages:

„Der Fokus der Keynote war, zu erläutern, wo Künstliche Intelligenz heute ist und darauf einzugehen, dass die Erwartung, die zum Teil grassieren, nicht auf dem Stand der Leistung ist, die die Systeme jetzt aktuell haben, sodass wir immer wieder mit falschen Erwartungen konfrontiert werden. Diese falschen Erwartungen sind letztendlich marketinggetrieben. […] Das Ergebnis ist insofern negativ, als dass ich in vielen Gesprächen eine Skepsis gegenüber der Entwicklung oder auch dem Einsatz von KI hören. Das hängt damit zusammen, dass manche Anbieter die Leistungen ihrer Werkzeuge so sehr idealisieren, dass Menschen glauben, in Zukunft nicht mehr mit diesen maschinellen Leistungen mitthalten zu können. Das führt dazu, dass in Betrieben nicht begeistert über die Einführung von KI diskutiert wird, sondern eher Skepsis vorherrscht.“

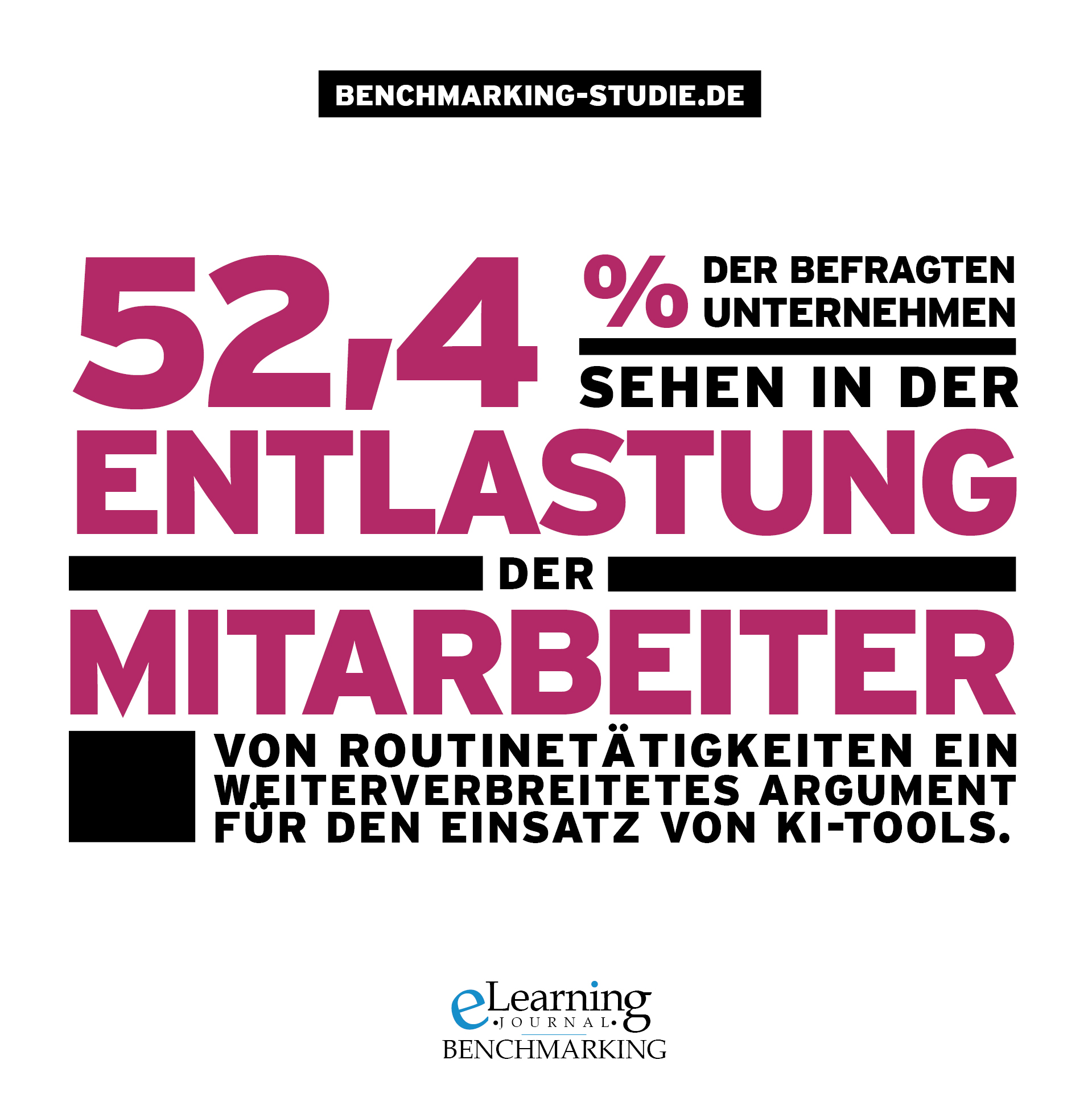

Die Aufklärung hinsichtlich der praxisbezogenen Nutzbarkeit von KI ist eine der entscheidenden Faktoren, die für einen erfolgreichen Veränderungsprozess mit dem Ziel der stärkeren Einbindung Künstlicher Intelligenz in Unternehmenskontexten wie der betrieblichen Bildung genannt werden können. Allerdings deuten die Ergebnisse unserer BENCHMARKING-Teilstudie: KI kommt nicht, KI ist schon da. auf eine Stabilisierung dieses Negativ-Trends hin.

In der Teilstudie: “Künstliche Intelligenz in der betrieblichen Bildung” gebe ich einen Basis-Einführung in die Grundbegriffe der Künstlichen Intelligenz und zeige anhand von praktischen Beispielen den aktuellen, praxisrelevanten Forschungsstand auf. Dabei zeigten die Umfrageergebnisse bei der Implementierung von KI einen deutlichen Trend zur Kurzfristigkeit: Wo Unternehmen vorher abgewartet haben, wie sich eine Technologie entwickelt, zeigt sich bei KI eine Entwicklung hin zum kurzfristigen „Try-Out“. Proportional dazu steigt das Wissen über KI oder KI-gestützte Tools im Unternehmen im Vergleich zum Vorjahr deutlich an, was dafür spricht, dass eben die von Karger genannten „falschen Erwartungen“ abgebaut werden. Dieser Trend mag zum einen mit der hohen Erwartungshaltung hinsichtlich der Entwicklungsgeschwindigkeit von KI zusammenhängen, zum anderen aber auch mit einer Veränderungskultur, die offener gegenüber neuen Technologien ist und den „Trial-and-Error“-Prozess als Möglichkeit zum Sammeln individueller Erfahrungen für das spezifische Unternehmen erkennen. Grundsätzlich kann festgehalten werden, dass „falsche Erwartungen“ und mangelnde Aufklärung als die primär hemmenden Faktoren im Etablierungs-Prozess von Künstlicher Intelligenz wirken. Umso gespannter sind wir entsprechend auf die Umfrageergebnisse der BENCHMARKING-Studie 2021 – diese wird dann auch abbilden, wie sich die Corona-Krise auf dieses Forschungsgebiet ausgewirkt hat.

Der Ratschlag, den Herr Karger am Ende des Podcast den Zuhörern mit auf Ihren Weg gegeben hat, kann entsprechend immer noch mit gutem Gewissen empfohlen werden:

„Immer bitte alles selber ausprobieren.“

Denn wer selber probiert, erhält auch die validen Ergebnisse, die er für sein Unternehmen und seine Zielsetzung benötigt.

Beste Grüße

Eure Lisa Coordes