Lernen 2030 – nicht nur das „Wie“ – auch das „Was“ verändert sich! Gerade in der Zeit der Corona-Krise hat Lernen mit elektronischen Medien Konjunktur. Bereiche wie die Allgemeinbildung, die Hochschulen, aber auch die Erwachsenenbildung bzw. berufliche Weiterbildung öffnen sich zwangsläufig den neuen Medien, um einen Ersatz für wegfallendes Präsenzlernen zu schaffen. Dabei wird schmerzhaft bewusst, wie groß der Nachholbedarf an vielen Stellen ist. Fortgeschrittene Akteure versuchen darüber hinaus die Krise als Chance zu nutzen, um einerseits ihre Reichweite zu erhöhen und andererseits die pädagogischen Möglichkeiten der digitalen Medien zu erschließen. Zu nennen sind in diesem Zusammenhang u.a. Schritte zur Individualisierung und Personalisierung von Lernprozessen, die Verstärkung der Handlungsorientierung durch Agieren im virtuellen Raum und die Hinwendung zum problemlösenden Lernen in der Arbeit in Echtzeit.

Autor: Prof. Dr. Dr. h.c. Lothar Abicht

So stark sich die Art, die Methode des Lernens auch ändert, an einer Stelle bewegen wir uns noch immer weitgehend auf ausgetretenen Pfaden. Das betrifft die zu lernenden Inhalte. Seit mehr als 20 Jahren wird verkündet, dass sich große Teile des notwendigen Wissens nur zwei oder drei Mausklicks entfernt befinden. Dennoch wurde diese triviale Feststellung bei der Auswahl der Inhalte und der Beantwortung der Frage, was wir lernen, wenig beachtet. Das Vollständigkeitsprinzip triumphiert auch im Zeitalter der Wissensexplosion weiter.

Intelligente digitale persönlicher Assistenten im Prozess der Wissenskommunikation

Bis 2030 werden wir über eine Vielzahl von digitalen intelligenten persönlichen Assistenten auf unterschiedlichen Entwicklungsniveaus verfügen, die spezifisches Wissen bereitstellen und dieses Wissen individualisieren, bevor es die Menschen erreicht. Diese Systeme werden in letzter Konsequenz in der Lage sein, unscharfe Fragestellungen, die sie über die unterschiedlichsten Schnittstellen erreichen, zu präzisieren und das Wissen in den Antworten gezielt so aufzubereiten, dass es anschlussfähig wird zu unserem aktuellen Wissen.

Ihre gemeinsame Grundlage sind Systeme der künstlichen Intelligenz, die in der Lage sein werden (bzw. es heute schon sind), Wissen aus der digitalen Welt mit Wissen über unsere Person zu verbinden, wenn wir das wollen und zulassen. Der Zugang zu Ihnen erfolgt (heute) über digitale Endgeräte wie unser Smartphone oder intelligente Lautsprecher wie Alexa, zukünftig vermutlich auch über Computer-Brain-Schnittstellen. Aber nicht nur wir selbst werden über solche Assistenten verfügen. Sie werden uns auch zunehmend an allen Schnittstellen zwischen Menschen und Maschinen begegnen und im Einzelfall wird es kaum noch möglich sein,

herauszufinden, ob wir es mit einem Menschen oder einem Computer zu tun haben, mit dem wir kommunizieren. Auch dafür existieren heute schon vielfältige Beispiele.

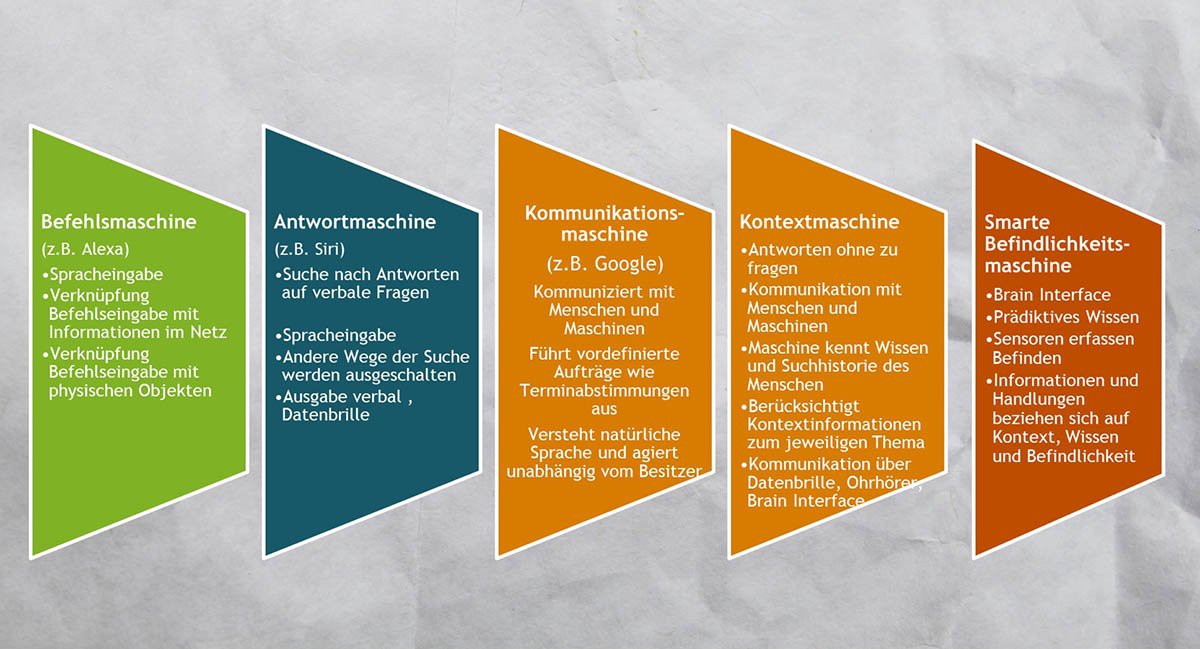

Bei der Entwicklung der digitalen Assistenten lassen sich nach dem gegenwärtigen Wissensstand fünf Stufen unterscheiden, zwischen denen es erhebliche Überschneidungen gibt. Die Stufenfolge ist so zu verstehen, dass jede folgende Stufe auch die Funktionen der darunter liegenden Stufe erfüllen kann und zusätzliche Fähigkeiten aufweist. Jede dieser Stufen kann erhebliche Auswirkungen auf die Gestaltung von Lernprozessen haben, insbesondere auf die Frage, was wir zukünftig selbst wissen müssen und was wir bei Bedarf von der Maschine erhalten.

Befehlsmaschine: Die erste Stufe erleben wir gegenwärtig u.a. mit den Angeboten von Amazon. Der intelligente Lautsprecher Alexa steht inzwischen in Hunderttausenden von Haushalten. Es handelt sich dabei in erster Linie um Befehlsmaschinen, die Aufträge ihrer Besitzer ausführen. Sie bedienen Funktionen im Smart Home, kaufen auf Befehl im Internet ein, spielen Musik oder Videos. Sie können auch Fragen beantworten und über verbale Kanäle Zugang zu Wissen schaffen. Ihre Bedeutung für Lernprozesse bzw. die Frage, was wir noch selbst lernen müssen, ist begrenzt und geht mit der Beantwortung von einfachen Fragen in Richtung der zweiten Stufe digitaler Assistenten.

Antwortmaschine: Die zweite Stufe sind Systeme wie Cortana von Microsoft oder Siri von Apple, welche die Funktion von Antwortmaschinen haben. Im Unterschied zu Suchmaschinen liefern die weiterentwickelten Antwortmaschinen der Zukunft genau eine verbale Antwort auf eine konkrete verbale Frage, wenn die Menschen das wollen. Stimmt diese, so werden die Nutzer kaum noch mehrere Antworten vergleichen wie bisher, sondern sich auf die eine Antwort verlassen. Setzen sich die Antwortmaschinen durch, und insbesondere jüngere Menschen nutzen mit großer Begeisterung die Spracheingabe ihres Smartphones, werden sie das Suchverhalten im Internet grundlegend ändern. Es ist ein bisschen wie mit dem Navigationsgerät. Bei seiner Einführung haben die meisten von uns noch einen misstrauischen Blick auf die vertraute Karte geworfen, bevor sie losfuhren. Hat die Wegweisung ausreichend oft funktioniert, bauen wir Vertrauen auf und selbst der hilfsbereite Mitfahrer mit Ortskenntnissen bleibt von unseren Fragen unbehelligt. So ganz nebenbei wird auch noch eine Fiktion aus der Welt der Science-Fiction Filme wahr. Vielleicht kennen Sie Captain Kirk vom Raumschiff Enterprise, der seine Fragen direkt per Sprache an den Hauptcomputer des Schiffs richtete und von dort über eine sympathische Stimme Antwort erhielt. Mit dem persönlichen Assistenten verbal auf hohem Niveau kommunizieren zu können, ist eine herausragende neue Qualität. Wird eine spezifische Art von Wissen gesucht, müssen zukünftig nicht mehr vorgedachte Metadaten den Weg weisen. Die Maschine kann selbst den Kern einer unscharf formulierten Frage herausfinden und Antworten liefern, die denen von Expertinnen und Experten nahekommen.

Kommunikationsmaschine: Als dritte Stufe entstehen schon heute Verhandlungsmaschinen, die im Auftrag ihrer Besitzer mit anderen Menschen oder mit anderen Assistenten verhandeln. Verhandeln ist hier wörtlich gemeint im Sinne des Aushandelns eines vorher nicht bekannten, aber für beide Seiten akzeptablen Ergebnisses. Sie sind in der Lage, selbständig mit Menschen in natürlicher Sprache zu kommunizieren. Google hat bereits einen Prototyp entwickelt, der selbständig im Gespräch mit einem Restaurant oder einem Frisör die Details von Bestellungen abspricht. Die Kommunikation erfolgt in natürlicher Sprache, wobei die Kommunikation durch Verwendung von künstlicher Intelligenz und Deep Learning so gut ist, dass der menschliche Gesprächspartner nicht mehr merkt, dass er mit einer Maschine redet. Funktioniert die Verhandlung mit einem Menschen, ist es nur ein kurzer Weg, die Verhandlung zwischen Maschinen zu realisieren. Versuche von Facebook zur Kommunikation von Bots in Verhandlungsprozessen haben sogar dazu geführt, dass miteinander kommunizierende und verhandelnde Chatbots selbständig eine eigene Sprache entwickelt haben, die von der englischen Standardsprache abwich und (unbegründete) Befürchtungen nährte, die Chatbots würden sich der menschlichen Kontrolle entziehen. Verhandlungsmaschinen sind aber nicht nur für die Übertragung von zeitaufwendigen Abstimmungsprozessen geeignet. Sie können auch selbständig nach Wissen suchen und mit anderen Assistenten Vereinbarungen über die Verwendung des Wissens treffen. Vor allen aber werden sie zukünftig die Fähigkeit aufweisen, im Dialog mit den Nutzern schrittweise Antworten auf komplexe Fragen herauszuarbeiten. Assistent und Mensch bringen beide im Dialog ihr Wissen ein und entwickeln eine Antwort.

Kontextmaschine: Inzwischen befinden sich die Antwort- und Verhandlungsmaschinen auf dem Weg zu Kontextmaschinen als vierte Stufe. So kann beispielsweise Cortana als digitaler Assistent von Microsoft Zugang zu allen Dateien, E-Mails und Anwendungen des jeweiligen Nutzers erhalten. Auf diese Weise kann der Assistent den persönlichen Kontext des Nutzers kennenlernen und den Nutzer beraten. Google Now und Siri von Apple gehen in die gleiche Richtung, und auch Amazon setzt bei Alexa Algorithmen ein, die Nutzer analysieren. Es bleibt allerdings nicht bei der Analyse der Inhalte auf dem eigenen Rechner. Die Algorithmen echter Kontextmaschinen berücksichtigen zukünftig auch das Vorwissen, die Historie des Nutzers. Was hat er schon alles gelernt? Womit hat er sich intensiv beschäftigt und hat daher vermutlich vertiefte Kenntnisse? Denn die Kontextmaschine begleitet die Lernprozesse und kann sie dadurch nicht nur unterstützen, sondern auch katalogisieren. Die Kontextmaschinen liefern Antworten, die zunehmend den gesamten persönlichen Kontext der Suchenden berücksichtigen. Wer es zulässt, erhält auf diese Weise Informationen und Impulse, auch ohne spezifische Fragen zu stellen. Der Assistent erkennt selbstständig, in welchem äußeren Rahmen bzw. Kontext der Nutzer handelt, und liefert die dazugehörigen Hintergrundinformationen. Kontextmaschinen können auch im Lernprozess Funktionen übernehmen. Einerseits sind sie in der Lage, im Auftrag ihrer Besitzer Wissen in der Verhandlung mit anderen Menschen oder Chatbots zu präzisieren. Andererseits ist wahrscheinlich, dass sie auch Kommunikationsfunktionen von Lehrenden in Phasen des selbständigen Lernens übernehmen.

Befindlichkeitsmaschine: Doch auch die Kontextmaschinen stellen nur einen Zwischenstand dar. Die nächste, fünfte Stufe werden smarte Befindlichkeitsmaschinen sein. Diese erkennen nicht nur den Kontext der Lernenden und die Lernsituation. Über Systeme des Emotional Decoding oder Brain Interfaces sowie Sensoren zur Erfassung von Körperdaten gewinnen sie Informationen über die aktuelle emotionale Befindlichkeit des Menschen. Diese werden genutzt, um an den jeweiligen Zustand angepasste Informationen zu liefern. Wissen wird damit nicht nur individuell, sondern auch situativ und adaptiv. Insbesondere in Lernprozessen aber auch darüber hinaus bekommt jeder auf seine Person, seine Situation und seine Bedürfnisse zugeschnittene Informationen. Das verbessert nicht nur die Wissensaufnahme. Auch Lernprozesse können mit einer derartigen Funktion emotional optimiert werden. Diese emotionale Optimierung betrifft grundlegende Persönlichkeitsmerkmale und kann zur Berücksichtigung aktueller Stimmungen und emotionaler Zustände eingesetzt werden.

Einen zusätzlichen Entwicklungssprung erreichen die digitalen Assistenten, wenn sie smart werden und uns mit Befunden, Analysen und Vorschlägen konfrontieren, nach denen wir möglicherweise gar nicht gefragt haben. Das ist durchaus vorstellbar, denn schon heute ist Kreativität trotz gegenteiliger Annahmen keine Domäne des Menschen mehr. Das Softwareprogramm Painting Fool malt selbständig und nach eigenem Ermessen Bilder, die Kompositionssoftware Iamos hat Millionen von Songs jeden Genres komponiert.

Was müssen wir lernen, was müssen wir können?

Der digitale Assistent ist nicht nur eine stupide Erweiterung unseres Gedächtnisses, sondern er stellt Wissen situativ und entsprechend unserem emotionalen Zustand sowie prädiktiv bzw. vorausschauend zur Verfügung. Das gilt in Lernsituationen ebenso wie bei der Anwendung des Wissens in der Arbeit oder sonstigen Kontexten.

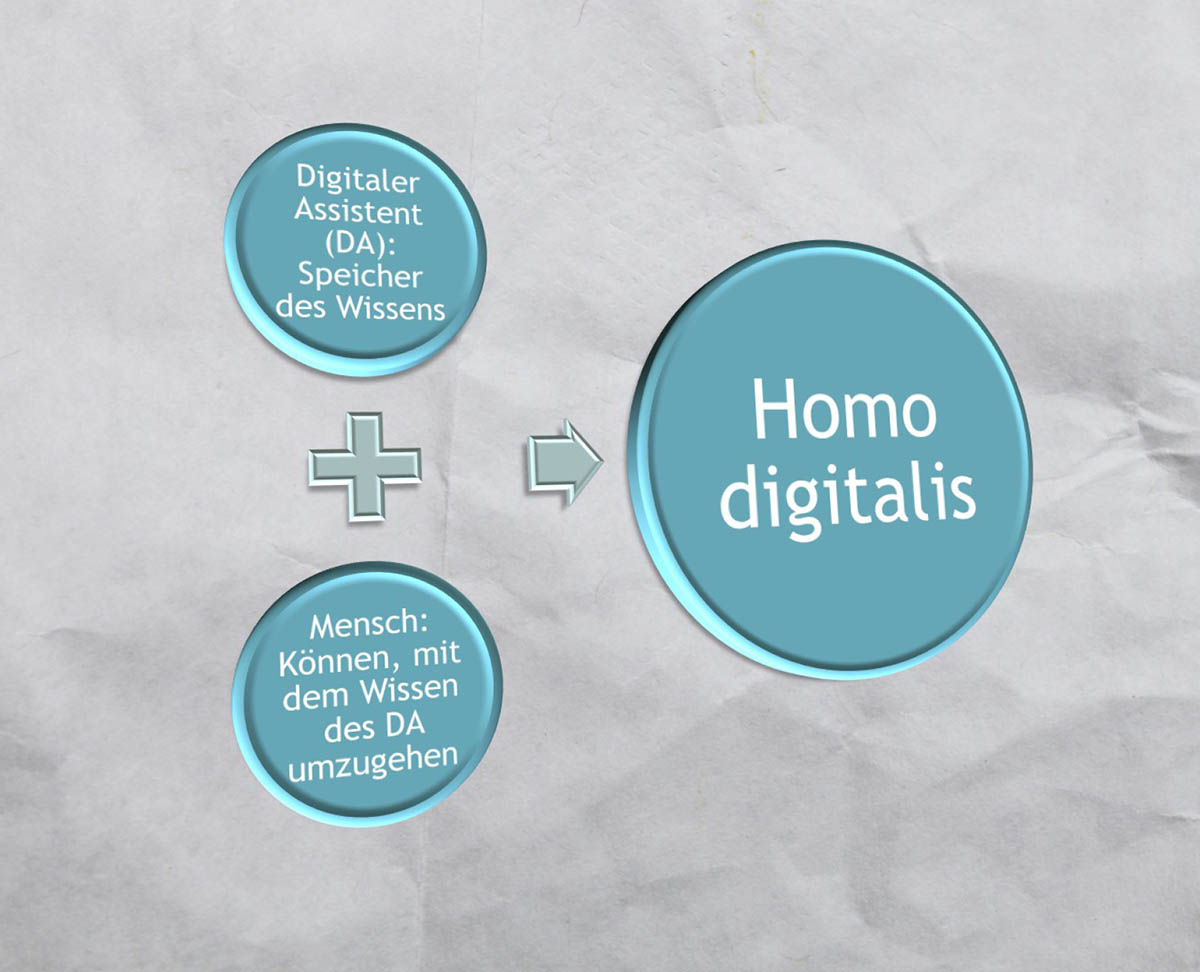

Wie werden sich Menschen verhalten und was müssen sie lernen, wenn ihnen derartige technische Erweiterungen ihrer Persönlichkeit verfügbar sind, die in der Summe zum Homo digitalis führen?

Zweifellos wird die Fähigkeit der Verbindung von Kontextinformationen mit der Realität zu einer wichtigen Kompetenz. Diese erfordert gleichermaßen Abstraktionsvermögen wie Praxiswissen. Notwendig sind grundlegende innere Modelle von der Wirklichkeit, um die konkreten Beispiele darin einordnen zu können. An dieser Stelle lassen sich auch Ansatzpunkte bestimmen, um das nötige Grundwissen in einer Zeit zu bestimmen, wenn alle Informationen in Echtzeit und persönlich aufbereitet zur Verfügung stehen. Das Grundwissen konzentriert sich auf zentrale wissenschaftlich abgesicherte und mit hoher Wahrscheinlichkeit längere Zeit stabile Axiome, auf denen andere Aussagen aufbauen. Ziemlich sicher wird der Umfang des Grundwissens deutlich gegenüber dem bisher vermittelten reduziert. Kompetenzen treten verstärkt an die Stelle von Wissen. Besonders wichtig ist dabei die Kompetenz, gekonnt mit dem Avatar umzugehen und ihn sowohl beim Erwerb von Wissen als auch bei dessen Anwendung permanent einzubinden.

Wenn persönliche digitale Assistenten einen permanenten Strom von personalisierten Informationen zur jeweiligen Lernaufgabe zur Verfügung stellen, dann unterscheiden sich Lernprozesse kaum noch von praktischen Problemlösungsprozessen. Das Lernen in der Arbeit und das Lernen im Lernlabor nähern sich immer mehr an. Lernen auf Vorrat wird zumindest teilweise ersetzt durch Lernen im Handlungs- und Problemlösungsprozess. Doch es bleibt ein Unterschied: Die mithilfe der digitalen Assistenten zu bearbeitenden Lernaufgaben können durchaus eine didaktische Struktur beinhalten. Diese kann intentionalen Charakter haben und muss für die Lernenden nicht unbedingt sichtbar sein. Das Lernen selbst erfolgt eher informell, ist aber nachhaltiger als viele künstlich herbeigeführte Lernsituationen traditioneller Art.

Der digitale Assistent wird sich aber bei entsprechender Programmierung nicht darauf bescheiden mit uns zu lernen, an unserer Stelle zu entscheiden oder geistige Routineaufgaben zu übernehmen. Er wird uns auch zeigen, welche Konsequenzen es hat, wenn wir uns kognitiv zurücklehnen und uns von der aktuellen Entwicklung abkoppeln. Denn er kennt uns genauso wie die Umwelt, den Kontext, in dem wir uns bewegen. In diesem Sinne kann er mehr Lernmotivation erzeugen, als der beste Lehrer bzw. die beste Lehrerin. Immer vorausgesetzt, die Daten, die der Assistent über uns hat, gehören auch wirklich dem jeweiligen Menschen und sind sicher vor Missbrauch.

Literatur

Schröder, Martin: Warum es uns noch nie so gut ging und wir trotzdem ständig von Krisen reden. Salzburg, München: Benventuro Verlag, 2018.

Janszky, Sven-Gabor/Abicht, Lothar: 2030. Wieviel Mensch verträgt die Zukunft. Leipzig: 2b AHEAD Publishing. Leipzig, 2018.

Hartung, Manuel J.: Sprache als nächster großer Schritt der Digitalisierung. In. Die Zeit vom 15.11.2017.

Pichai, Sundar: Keynote Google I/O 18. https://www.youtube.com/watch?v=ogfYd705cRs, 2018. – Aufgenommen: 12.05.2018.

Kühl, Eike: Eine Sprache macht noch keinen Terminator, http://www.zeit.de/digital/internet/2017-08/kuenstliche-intelligenz-sprache-lernen-facebook-chatbot, – Aufgenommen: 12.05.2018.

Harari, Yuval Noah: Homo Deus-Eine Geschichte von Morgen. 7. Auflage München: C.H.Beck, 2017, Position 6072.

Priddat, Birger P: Willkommen in der Welt des Homo digitalis. Hohe Luft kompakt. Sonderheft 2/2018.

Heller, Lydia: Kreative Maschinen: Kunst, ausgerechnet! Golem. https://www.golem.de/news/kreative-maschinen-kunst-ausgerechnet-1308-101192.html. – Aufgenommen 14.03.2019.

Der Autor:

Prof. Dr. Dr. h.c. Lothar Abicht

Als Bildungs- und Zukunftsforscher unterstützt er mit Büchern, Vorträgen und Seminarangeboten seine Leser, Studenten sowie Unternehmen und Bildungseinrichtungen bei der zukunftsorientierten Bewältigung des digitalen und demografischen Wandels. Dabei stützt er sich auf Ergebnisse seiner Forschungsarbeiten, die ihre Umsetzung in Projekten mit hunderten Teilnehmern fanden. Unternehmen buchen ihn für praxisorientierte und dennoch visionäre Vorträge und Beratungen.

Kontakt:

Prof. Dr. Dr. Lothar Abicht

Wissenschaftlicher Direktor

Cryco Think Tank for Future Studies

Dreischeibenhaus

D-40211 Düsseldorf

Tel: +49 (0) 211 / 882 503 45

abicht@cryco-tt.com

www.cryco-tt.com